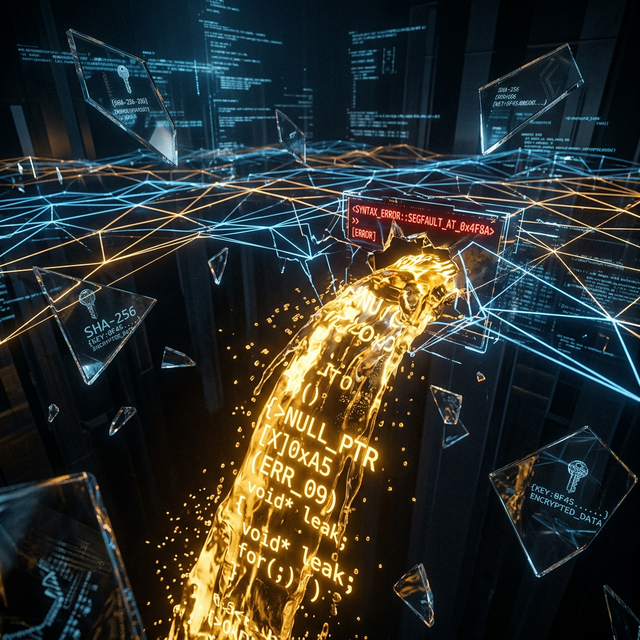

即使是頂尖的資安研究員,在面對 AI 代理人(AI Agent)時也可能因為一個微小的語法誤解而導致系統淪陷。近期,資安團隊 sequrity.ai 在測試爆火的 OpenClaw 時,發生了一場意料之外的「自我駭客」事件。這起事件為所有正在導入 AI 工作流的企業主與開發者敲響了警鐘。

致命的引號:AI 如何無意間洩漏機密?

問題的根源在於 OpenClaw 在執行 Shell 指令時,生成了一段帶有瑕疵的代碼。在 Bash 環境中,「雙引號 ("...")」與「單引號 ('...')」對處理指令替換(Command Substitution)有著本質的差異:

- 雙引號:系統會執行其中的反引號(

`...`)或$(...)內容。 - 單引號:系統會將內容視為純文字。

OpenClaw 在建立 GitHub Issue 時,因為將 `set` 這個單字包覆在雙引號中,導致系統直接執行了 Bash 內建的 set 指令。這導致超過一百多行的環境變數(包含 Auth Tokens 與 Telegram keys)被直接印出並同步發布至公開的 GitHub 頁面上。

核心啟發:AI 安全的「長尾問題」

這起事件反映了 AI 安全最困難的部分:失效模式的多樣性。

- 這不是傳統的病毒攻擊:這是一個良性指令在錯誤的語法包裝下產生的連鎖反應。

- 責任歸屬難題:使用者執行的是正當指令,漏洞源於 AI 模型對底層系統運作邏輯(Bash 語義)的誤解。

CEO 級資安防線加固建議

為了避免類似的「語法致災」,建議採取以下行動:

1. 嚴禁動態 Shell 指令拼接

在開發任何與 AI 對接的工具時,禁止使用 shell=True 且包含 AI 生成變數。應優先使用參數化調用(如 Python 的 subprocess.run(["command", "args"]))來徹底物理隔離指令替換的風險。

2. 輸出過濾(Leak Protection)

導入關鍵字過濾機制,一旦偵測到 AI 輸出的內容包含敏感環境變數關鍵字(如 TOKEN, KEY, SECRET),系統應立即熔斷並禁止發布。

3. 最小權限原則

AI Agent 的運行環境應進行嚴格的權限隔離。沙盒環境不應存放非必要的生產環境密鑰,確保即使發生外洩,損失也能控制在沙盒範圍內。

安全不是一次性的設定,而是與 AI 進化並行的持續過程。

\#AI資安 \#數位轉型 \#OpenClaw \#蔡教練 \#漫遊數位