Gemma 4「微型引擎」革命:告別巨型模型迷思,開啟個人 AI 推理力時代

AI 的規則,正在被悄悄改寫。過去幾年,整個產業的邏輯幾乎只有一條:模型要夠大,才夠聰明。但 Google 最新發布的 Gemma 4,正在用一種截然不同的邏輯,宣告這個時代的終結。

「越大越聰明」是一個過時的迷思

長期以來,AI 圈有一個根深蒂固的信仰:把全世界的知識都塞進模型,體積越大,表現越強。這條路走到極致,代價卻越來越難以承受——高延遲、高能耗、高成本,三座大山壓在每一個想要落地應用 AI 的開發者身上。

然而問題的根本從未是「記憶力」,而是「推理力」。

現代 AI 應用的核心任務——複雜邏輯推理、多模態創作、程式碼自主生成、數據分析——沒有一項真正需要模型死背海量事實。RAG(檢索增強生成)技術的成熟,讓 AI 學會即時查找外部知識庫。這意味著,真正決定模型優劣的,是它能否用最少的資源完成最精準的推理。

Gemma 4:將極致運算力壓縮進微型封裝

Gemma 4 系列涵蓋三個層次,其中最令人矚目的莫過於 26B A4B MoE(混合專家)架構。它擁有 260 億參數的知識庫,但每次推理時只喚醒 38 億個活躍參數——如同一個擁有數百位專家的智庫,每次只精準調動最適合的人選。

- MoE 架構:展現巨型模型的推理深度,卻保持微型模型的極速與省電。

- Flagsip 性能:31B Dense 核心在 AIME 數學推理測試中拿下 89.2% 的成績,擊敗體量大其十倍的舊型模型。

- 全能感官:原生支援視覺、影片與音訊 OCR,讓端側設備長出全能感官系統。

實戰觀測:在你的 Mac Mini 上養一隻數位龍蝦

在配備 Mac Mini M2 Pro (32GB RAM) 的實測中,Gemma 4 展現了驚人的本地適應力。相較於雲端模型,本地部署具備零延遲、高隱私與離線作業的絕對優勢。

RAG 本地優化甜蜜點:

- 精確餵食量:最佳效能點為「4 篇 x 1000 字」。來源過多反而會稀釋指令遵循度。

- 關閉 Thinking Token:在專業文本彙整場景下,關閉思考標籤能釋放更多推論空間,提升回答品質。

- 量化層級選擇:E4B Q3 是 8GB 機台上的平衡之選,而 32GB 機器則可無痛執行 26B MoE 或 31B Dense 原生模型。

最後一句話:AI 算力正在回歸口袋與桌面

過去,AI 的算力是稀缺資源,被少數人把持。現在,Gemma 4 讓它走進了每個人的書桌。這才是真正偉大的地方——它不只讓 AI 更聰明,它讓聰明的 AI,變得觸手可及。

🚀 準備好建構您的「個人 AI 指揮系統」了嗎?

如果您想了解如何將 Gemma 4 這類微型引擎整合進您的日常工作流,歡迎聯繫我們進行系統預約。

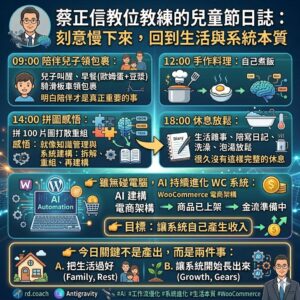

蔡教練|漫遊數位