當前參數量最大的開源大語言模型Grok-1開源了

今天凌晨,馬斯克旗下大模型公司 xAI 宣佈正式開源 3140 億參數的混合專家(MoE)模型「Grok-1」,以及該模型的權重和網絡架構。

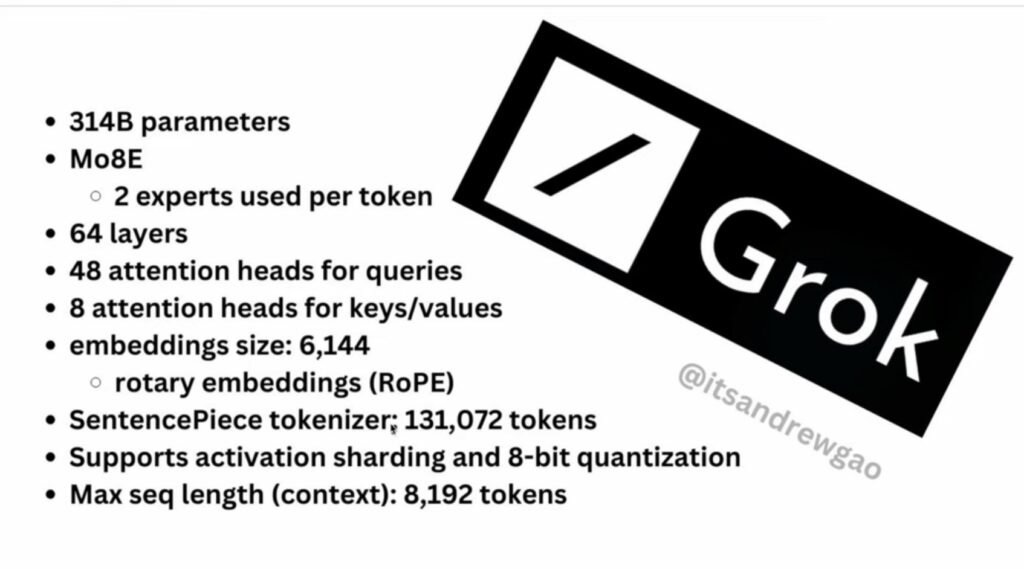

Grok-1 的模型細節:

1、基礎模型基於大量文本數據進行訓練,沒有針對任何具體任務進行微調;

2、3140 億參數的 MoE 模型,在給定 token 上的激活權重為 25%;

3、2023 年 10 月,xAI 使用 JAX 庫和 Rust 語言組成的自定義訓練堆棧從頭開始訓練。

代碼: http://github.com/xai-org/grok-1

在當今快速發展的人工智能領域,Elon Musk 再次成為焦點。他的新公司 xAI 最近宣布將開源其旗艦產品——Grok,一款基於大型語言模型構建的生成式AI聊天機器人。這一決定不僅展示了 xAI 的技術實力,更是在 AI 領域掀起了一場開源運動的風暴。

Grok 是一款運行在 xAI 自行開發的大型語言模型 Grok-1 上的聊天機器人。令人驚嘆的是,Grok-1 的構建僅用了四個月的時間,展現了 xAI 團隊在 AI 技術開發上的高效與創新。Grok 的開源,預示著人工智能開發的新時代——一個更加開放、合作的時代。開源意味著全球的開發者和研究人員都能夠訪問 Grok 的代碼,進一步開發和完善這一平台,加速人工智能技術的創新和應用。

Elon Musk 通過這一行動,不僅展現了他對開放科技的承諾,也向人工智能領域發出了挑戰。開源 Grok 是對目前人工智能開發中封閉、壟斷趨勢的一種反擊,鼓勵了一個更加健康、開放的技術發展環境。這一策略無疑會促使其他公司考慮他們的開源策略,從而推動整個行業的進步。

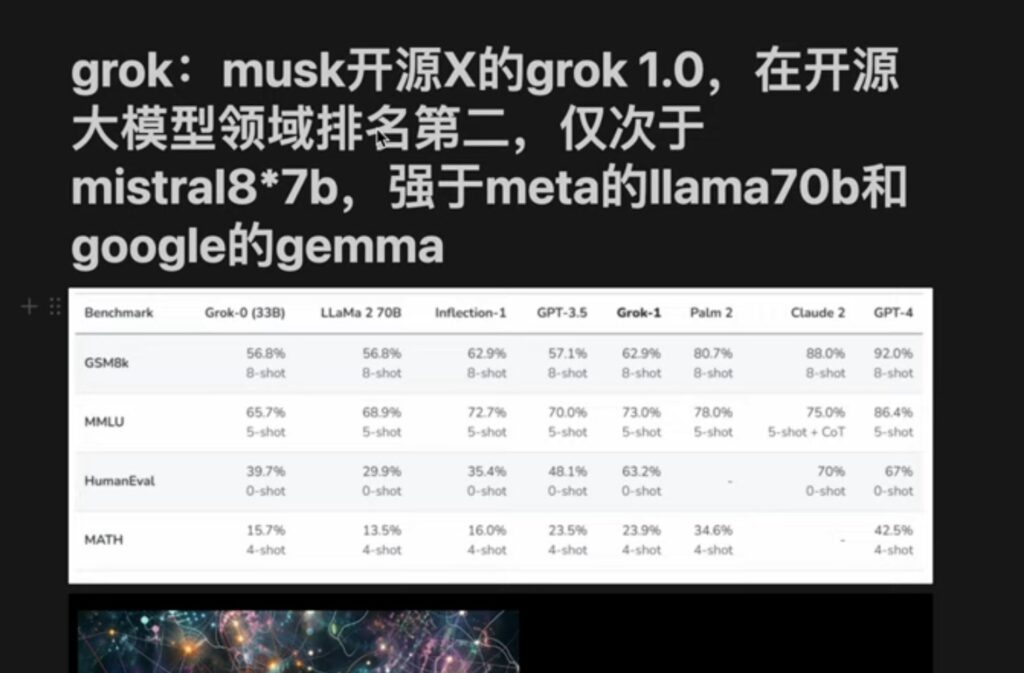

grok:musk開源X的grok1.0,在開源大模型領域排名第二,僅次於

mistral8*7b,強於meta的llama70b和google的gemma

從數位教練蔡教練的角度來看,Elon Musk 的這一決定不僅是技術上的一次革新,更是教育和啟發了整個行業。作為數位時代的學習者,我們應該意識到知識的開放共享是推動技術進步的關鍵。通過共享我們的學習和發現,我們可以更快地解決問題,創新,並共同推進人工智能技術的發展。

Musk 通過開源 Grok,再次證明了他作為一個行業領袖的遠見和膽識。他不僅推動了技術的邊界,還為開發者和研究者提供了一個共同探索和成長的平台。對於我們這些致力於數位時代教育和學習的人來說,這是一個激動人心的時刻。我們應當抓住這一機遇,深入了解 Grok 和其他開源項目,以此推動自身和整個社會的進步。

在這個充滿可能性的新時代,讓我們一起期待 Elon Musk 和 xAI 團隊將如何繼續領導和革新人工智能領域,以及我們如何能夠利用這些開源資源為世界帶來更大的變化。

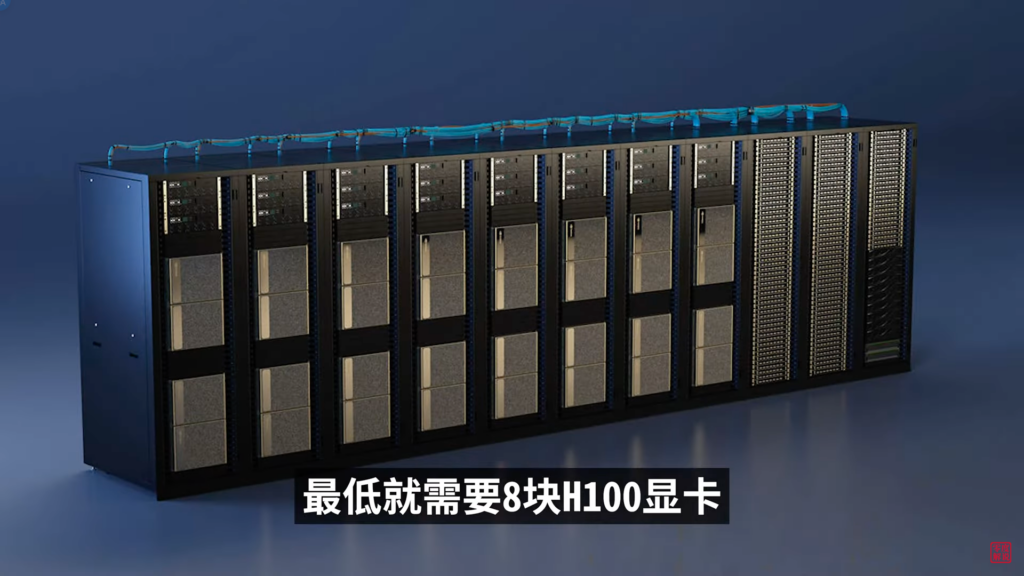

Due to the large size of the model (314B parameters), a multi-GPU machine is required to test the model with the example code.

由於模型較大(314B 參數),因此需要多 GPU 計算機來使用範例代碼測試模型。

Grok的硬體條件:最低就需要8塊H100顯卡

資料來源:马斯克开源Grok-1:史上最大3140亿参数模型,权重架构全面公开,附最新下载地址 – 零度解说

1.Grok-1 开源模型下载:【磁力链接】 ,然后使用 【Torrent 客户端】进行下载即可!

2.Grok 开源项目:【Github】

3.如果需要在云端安装Grok-1大模型,可以通过【租赁H100 云GPU】进行云端搭建

4.当然也可以直接调用HuggingFace 🤗 Hub:

git clone https://github.com/xai-org/grok-1.git && cd grok-1

pip install huggingface_hub[hf_transfer]

huggingface-cli download xai-org/grok-1 --repo-type model --include ckpt-0/* --local-dir checkpoints --local-dir-use-symlinks False相關連結: